Кими К2, открытая агентная модель от Moonshot AI

Введение

Агентный интеллект — это парадигма в области искусственного интеллекта, которая фокусируется на создании автономных сущностей, или «агентов», способных воспринимать свою среду, размышлять о своих наблюдениях, принимать решения и предпринимать действия для достижения конкретных целей. Этот подход подчеркивает способность систем ИИ работать независимо, адаптироваться к меняющимся условиям и учиться на своем опыте, часто без постоянного человеческого контроля. Kimi K2 — это модель с 1 трлн параметров открытого веса, предназначенная для агентного использования — она демонстрирует передовые результаты в области пограничных знаний, математики и программирования.

Обзор модели

| Спецификация | Актуальность |

|---|---|

| Смешанная модель экспертов | Архитектура Смешанной Экспертизы (MoE) позволяет увеличить размер и качество модели, одновременно снижая вычислительные затраты. Она использует разреженные слои полносвязной нейронной сети (FFN) (эксперты) и сеть ворот (роутер), чтобы избирательно направлять токены к топ-k экспертам, активируя только подмножество параметров для каждого токена. Этот подход позволяет создавать более крупные модели без пропорционального увеличения вычислительных затрат. |

| 1 триллион общих параметров, 32 миллиарда активных параметров | Поскольку K2 является архитектурой MoE, существуют общие и активные параметры. Общие параметры относятся к сумме всех параметров по всей модели, включая все экспертные сети, сеть маршрутизации/гейтинга и общие компоненты, независимо от того, какие эксперты используются во время вывода. Это контрастирует с активными параметрами, которые учитывают только подмножество параметров, используемых для конкретного ввода — обычно это активированные эксперты плюс общие компоненты. |

| Оптимизатор MuonClip | Muon, хотя и является экономичным оптимизатором, нуждается в модификации для обучения в больших масштабах. Оптимизатор MuonClip, представленный в разделе 2.1 технического отчета Kimi K2, является Muon, интегрированным с уменьшением веса, согласованным RMS-сопоставлением и QK-Clip. |

Предварительные требования

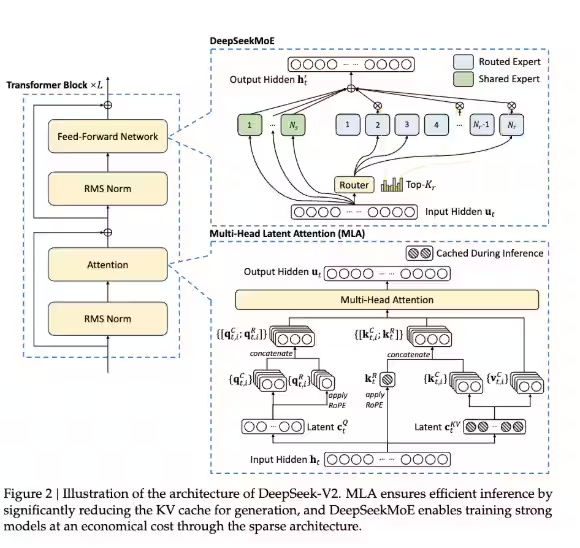

Мы рекомендуем вам прочитать технический отчет Kimi K2 вместе с этой статьей для получения дополнительной информации и контекста. Чтение о DeepSeek V3 также может быть полезным, но не является обязательным, поскольку архитектура Kimi K2 схожа, используя многоголовое латентное внимание с скрытым размером модели 7168 и скрытым размером эксперта MoE 2048.

Ниже приведенная фигура из технического отчета K2 также демонстрирует архитектурные сходства и различия между Kimi K2 и DeepSeek-V3.

Цель этой статьи — подробно описать ключевые моменты и сделать контент более доступным для вас. В отличие от этой статьи, технический отчет проходит через процесс (предварительное и последующее обучение, инфраструктура, оценка) более последовательным образом. Здесь мы пытаемся сгруппировать концепции по их роли в общей производительности Kimi K2. Мы решили не углубляться в оценки, но обязательно ознакомьтесь с разделом 4 технического отчета и протестируйте модель сами, чтобы лучше понять ее производительность.

Существуют несколько целей, которые повлияли на то, как был разработан Kimi K2:

-

Уменьшить переобучение

- Уменьшите потери на валидации

- Максимизируйте эффективность токенов

Мы собираемся подробнее рассказать о том, как исследователи решили эти задачи.

Уменьшить переобучение

Низкое значение валидационной потери указывает на то, что выученные моделью характеристики и шаблоны обобщаются за пределами обучающих данных. Это метрика, которую исследователи и практикующие специалисты по ИИ часто отслеживают при принятии архитектурных решений, таких как увеличение разреженности.

Спарсити

Скорость рассчитывается как общее количество экспертов, деленное на количество активированных экспертов. Kimi K2 увеличила разреженность по сравнению с DeepSeek-V3, увеличив общее количество экспертов, в результате чего разреженность составила 48 (384/8). Это значение было выбрано для балансировки производительности (нижее значение валидационной потери) с растущей сложностью инфраструктуры, которую приносит более высокая разреженность.

Максимизация эффективности токенов

Эффективность токенов — это то, насколько производительность улучшается с каждым потребляемым токеном во время обучения.

Нам важна эффективность токенов, потому что запас высококачественных токенов ограничен, и поэтому их следует максимально использовать. Исследователи объясняют, что повторное использование одних и тех же токенов (большее количество эпох) неэффективно, так как может привести к переобучению и снижению обобщающей способности. Это побудило их переформулировать высококачественные токены, относящиеся к областям знаний и математики.

Перефразирование >>> Больше эпох???

Переформулирование знаний

Для достижения повышенной обобщаемости по отношению к семантическим токенам, исследователи разработали «конвейер перефразирования», состоящий из трех основных элементов: подсказок, предназначенных для генерации стилистически разнообразных, но при этом фактически точных текстовых вариаций; сегментированного авторегрессионного переписывания, позволяющего лучше сохранять согласованность и предотвращать потерю информации в длинных документах (ниже представлено), и верификации “семантического соответствия” для каждого сгенерированного сегмента с его источником.

Исследователи использовали SimpleQA для оценки эффективности увеличения данных с помощью перефразирования. Похоже, что перефразирование с 1 эпохой превосходит 10 эпох.

Перефразирование данных по математике

Математические документы перезаписываются в стиле «учебной записи», следуя подходу «сжимающей математики», представленному в статье «Переписывание данных предварительной тренировки улучшает производительность LLM в математике и коде.»

Мюон

Основная задача оптимизатора заключается в минимизации «функции потерь», которая quantifies разницу между предсказаниями модели и фактическими желаемыми результатами. Путем систематического регулировки параметров оптимизаторы улучшают общую производительность модели, ускоряют сходимость обучения, повышают точность и помогают предотвратить такие проблемы, как переобучение.

Мюон (импульс, ортогонализированный методом Ньютона-Шульца) является оптимизатором, который обновляет параметры 2D нейронной сети в два этапа: сначала он генерирует обновления с использованием метода стохастического градиентного спуска (SGD) с моментумом, затем уточняет эти обновления с помощью итерации Ньютона-Шульца перед их применением к параметрам.

Лунный свет — это модель MoE с параметрами 3B/16B (активированные/всего), обученная на 5,7 ТРИЛЛИОНА токенов — что делает её первой крупномасштабной моделью, обученной с использованием Muon.

Хотя Muon продемонстрировал сильные результаты при обучении небольших языковых моделей, исследователи в Muon Is Scalable For LLM Training показали, что Muon можно масштабировать, добавляя снижение веса и тщательно настраивая масштаб обновления на параметр.

Тем не менее, постоянной проблемой, наблюдаемой при увеличении масштабов от Лунного света, является нестабильность обучения, наблюдаемая с раздувающимися логитами внимания. Приложение E технического отчета объясняет, почему Muon более подвержен раздуванию логитов.

Управление нестабильностями во время обучения

MuonClip

Возможно, эффективность MuonClip можно лучше всего объяснить на приведенной ниже иллюстрации.

MuonClip улучшает обучение LLM, ограничивая логиты внимания, что ведет к более плавным кривым потерь и устраняет всплески.

Гибкая учебная инфраструктура

Чтобы понять раздел 2.4 технического отчета, мы рекомендуем «Ультра-мастеркласс: Обучение LLM на кластерных GPU» от Hugging Face. Этот ресурс предоставляет ценные идеи о стратегиях параллелизма (включая экспертный, конвейерный и параллелизм Zero-1 Data), большие требования к памяти для активаций, объяснение селективной пересчета, преимущества планирования 1F1B в оптимизации использования памяти и наложении коммуникации и вычислений, а также обучение с переменной точностью.

Увеличение эффективности вывода

Снижение количества голов внимания

Агенты часто должны учитывать большие объемы контекста, предыдущие взаимодействия и подробные инструкции. Ясно, что основное внимание в Kimi K2 уделяется агентным случаям использования из-за их приоритета на выводах, а не на незначительных улучшениях производительности с большим количеством голов внимания.

Учитывая увеличение производительности с разреженностью 48 и значительные накладные расходы на вывод, связанные с большим количеством голов внимания при увеличенных длинах последовательностей, исследователи выбрали 64 головы внимания вместо 128 голов внимания в статье DeepSeek V3.

RL Infra

Это действительно интересно. Здесь обучающий и выводящий движки находятся на одном рабочем процессоре — где движок, который не работает, освобождает свои ресурсы GPU, чтобы предоставить их движку, который активно работает. Во время каждой итерации обучения с подкреплением выводящий движок генерирует новые данные для обучения.

Агентное синтез данных

Возможности Kimi K2 основываются на масштабной агентовой синтезе данных и обучении с подкреплением. Его конвейер, вдохновленный ACEBench, симулирует сценарии использования инструментов, создавая области с инструментами и агентами, которые взаимодействуют в многоповоротных сценариях, оцениваемых по критериям с помощью судьи на основе LLM. Этот процесс генерирует обучающие данные для модели.

Фигура из блога о запуске Kimi K2

Дополнительная информация/ресурсы

Многие из них также упоминаются в статье K2:

Муон: оптимизатор скрытых слоев в нейронных сетях | Блог Келлера Джордана

Kimi K1.5: Масштабирование обучения с подкреплением с помощью LLM: Значительное количество деталей, опущенных в статье Kimi K2, можно найти в статье Kimi K1.5 из-за пересечения в методологии. K1.5, будучи предшественником Kimi K2, включает в себя пайплайны обработки данных (Приложение B), которые были использованы для обработки корпуса предобучения K2 объемом 15,5 ТРИЛЛИОНА токенов.

Здесь мы изучаем различные области предобученного корпуса (английский, китайский, код, математика и логика, а также знания).

Приложение C содержит описания эталонов, использованных для оценки модели, таких как LiveCodeBench, AIME 2024 и др.

Объяснение DeepSeek-V3 1: Мульти-головное латентное внимание: Этот блог пост прекрасно объясняет MLA.

Заключение

Технический отчет Kimi K2 является отличным ресурсом для тех, кто интересуется тем, что входит в процесс обучения массовым агентным моделям MoE. В нем четко акцентируется внимание на длинных контекстах, эффективности вывода, стабильности обучения, увеличении данных и обучении с подкреплением. Есть некоторые разделы, которые мы не полностью раскрыли, но можем рассмотреть в последующих статьях – особенно касающиеся послебучения, такие как обучение агентных моделей использованию инструментов и то, как использовалось обучение с подкреплением. Оставайтесь с нами!

Мы надеемся, что вы найдете эту статью полезной. Желаем удачного обучения!

Добавить комментарий